Les systèmes d’intelligence artificielle (IA) sont aujourd’hui moins chers à former que jamais, c’est l’affirmation qu’a faite ARK Invest dans une analyse publiée en mai dernier.

Alors que la loi de Moore fait référence à la tendance selon laquelle le nombre de transistors d’un circuit intégré double tous les 1,5 an, l’analyse soutient que le coût de la formation de l’IA s’améliore à un rythme 50 fois supérieur à celui de la loi de Moore, a expliqué James Wang de ARK Invest, un ancien ingénieur de NVIDIA. Selon Wang, après seulement cinq ans de développement, le deep learning semble avoir atteint un point de basculement à la fois en termes de coût et de performance, ouvrant la voie à une adoption généralisée au cours de la prochaine décennie.

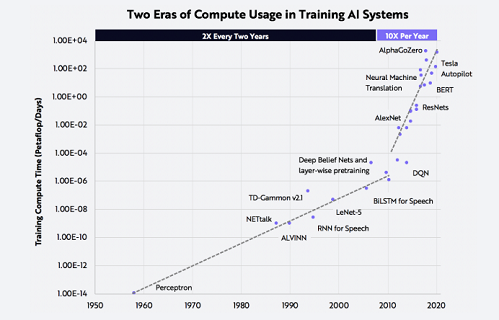

Dans son rapport, ARK a constaté que si les ressources informatiques consacrées à la formation a doublé en conformité avec la loi de Moore de 1960 à 2010, la complexité du calcul de formation – la quantité de pétaflops par jour – a augmenté de 10 fois par an depuis 2010. Parallèlement, les coûts de formation ont diminué de dix fois par an au cours des trois dernières années. En 2017, le coût de la formation d’un classificateur d’images comme ResNet-50 sur un cloud public était d’environ 1000 dollars, alors qu’en 2019, il était d’environ 10 dollars.

« Nous pensons que les entreprises ont été largement incitées à augmenter les ressources informatiques à un rythme cinq fois supérieur à celui de la loi de Moore : les avantages concurrentiels significatifs en matière de génération de revenus et de coût du matériel diminuent assez rapidement pour continuer à alimenter la bête. Alors que les sociétés Internet dites « hyperscale » ont pris les rênes des universités et formé des réseaux d’apprentissage profond sur leurs données, elles ont budgétisé des centaines de millions de dollars pour le matériel d’IA, espérant des taux de retour sur investissement supérieurs au fil du temps », a écrit Wang.

Synced a également fait un rapport sur XLNet, un nouveau modèle de langage développé par CMU et Google Research qui surpasse le précédent modèle SOTA BERT (Bidirectional Encoder Representations from Transformers) sur 20 tâches linguistiques. Ce qui peut en surprendre plus d’un, c’est le coût ahurissant de la formation du modèle XLNet. Un récent tweet d’Elliot Turner – entrepreneur et expert en IA qui est maintenant le PDG et cofondateur d’Hologram AI – a suscité une discussion animée sur les médias sociaux. Turner a écrit « il en coûte 245 000 dollars pour former le modèle XLNet (celui qui bat BERT sur les tâches de PNL)».

—————