Publié dans : Technologie

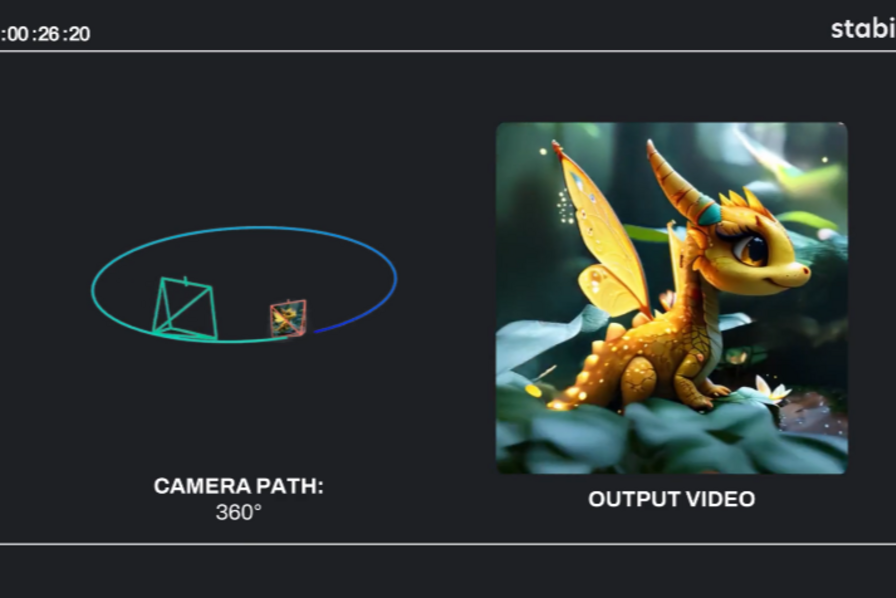

Les images deviennent des vidéos en quelques secondes. C’est l’ambition de Stability AI avec son modèle Stable virtual camera, actuellement publié en preview pour la recherche. « Ce modèle de diffusion multi-vues transforme les images 2D en vidéos 3D immersives avec une profondeur et une perspective réalistes, sans reconstruction complexe ni optimisation spécifique à la scène ».

Un rendu net sous toutes les coutures

Les fonctions liées au modèles sont multiples : il peut prendre en charge les trajectoires de caméra définies par l’utilisateur ainsi que plusieurs chemins de caméra dynamiques, notamment à 360 degrés, lemniscate (chemin en forme d’infi), spirale, zoom avant/arrière Dolly, zoom avant/arrière, avancer, reculer, panoramique vers le haut et vers le bas ainsi que panoramique vers la gauche/droite.

Des performances à contrebalancer avec les limites du modèle

La start-up est toutefois consciente de certaines limites liées à son modèle, d’où sa publication auprès d’un cercle restreint d’utilisateurs. « Dans sa version initiale, Stable Virtual Camera peut produire des résultats de qualité inférieure dans certains scénarios. Les images d’entrée représentant des humains, des animaux ou des textures dynamiques comme l’eau produisent souvent des résultats dégradés, concède-t-elle. De plus, les scènes très ambiguës, les trajectoires de caméra complexes croisant des objets ou des surfaces, et les objets de forme irrégulière peuvent provoquer des artefacts de scintillement, en particulier lorsque les points de vue cibles diffèrent sensiblement des images d’entrée ».